Ho appena visto questo in-cre-di-bi-le video (mi ci ha portato un post di Blenderartists, questo):

si tratta di un nuovo (credo, mai visto niente del genere prima) per

- modellare oggetti 3d estraendo visualmente le informazioni da una-singola-foto

- l’oggetto viene “facilmente” modellato e texturizzato semi-automaticamente in base alla sua immagine nella foto

- lo sfondo dietro l’oggetto viene ricostruito con algoritmi tipo liquid rescale di gimp, o così mi pare

- l’oggetto ricostruito, sovrapposto allo sfondo “svuotato” può essere a quel punto rimosso, modificato con facilità come se l’immagine fosse una scena 3d finita.

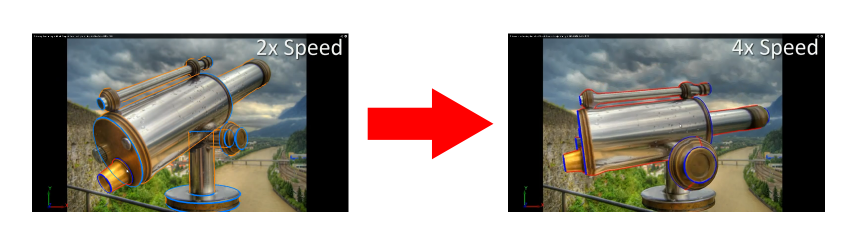

esempio?

Ovviamente l’algoritmo non potrebbe ricostruire il “lato nascosto” se non basandosi sulla supposizione che valgano prospettiva e simmetria, e credo anche che i contorni dell’oggetto siano “separabili” in qualche modo dallo sfondo (altrimenti, andrebbe aiutato), quindi non fa miracoli! Ma ci si avvicina, decisamente… 🙂

Ma è molto più semplice da capire se… guardate il video, qui sotto:

… e non è un fake!

Alcuni ricercatori “israeliani”: Tao Chen · Zhe Zhu · Ariel Shamir · Shi-Min Hu · Daniel Cohen-Or, che fanno parte di un centro interdisciplinare israeliano (IDC Herzliya) hanno pubblicato un lavoro relativo a questo nuovo metodo, il cui “abstract” è possibile leggere online, qui: http://www.faculty.idc.ac.il/arik/site/3Sweep.asp

Si tratta di una tecnica interattiva per manipolare semplici forme 3D estraendoli da una singola fotografia, mediante la comprensione dei componenti della forma, le relative proiezioni geometriche, e le relazioni con il resto della scena.

Si tratta di compiti cognitivi piuttosto semplici per gli esseri umani ma sono particolarmente difficili per gli algoritmi automatici. L’approccio utilizzato dai ricercatori combina le capacità cognitive dell’uomo con la precisione computazionale della macchina per risolvere questo problema complesso.

La tecnica fornisce all’utente gli strumenti per creare rapidamente oggetti 3D modificabili: l’assistenza “umana” è necessaria per separare “visivamente”, in base ad una sola immagine, la complessità di un oggetto reale nei suoi componenti, fornendo anche indicazioni sulla posizione geometrica nello spazio, un compito “naturalmente” molto semplice per un umano.

Il funzionamento è basato sulla definizione di tre “tratti” (da cui il nome “3-sweep”), adattandoli manualmente alla struttura della forma come è visibile in fotografia, ed ogni tratto definisce una delle tre dimensioni dell’oggetto.

Il computer disegna quindi il modello dell’oggetto adattandolo all’immagine nella fotografia, mantenendo però anche coerenza vari vincoli geometrici dovuti alla sua struttura 3D complessiva.

Una volta che l’oggetto 3D è stato “estratto”, può essere rapidamente modificato, riorientato, duplicato e messo di nuovo in foto o scene in 3D, permettendo così un nuovo metodi di un modello 3D, “guidato dalle immagini”, in un modo altrimenti impossibile da ottenere.

Una delle possibile applicazioni potrebbe anche essere permettere la “copia di oggetti” da stampare in 3D, solo basandosi su una foto…!

Ora, se solo fosse possibile avere questo in Blender, nella prossima release… 😀

Marco